| 基于空间语义信息特征融合的目标检测与分割 |

| |

| 作者姓名: | 郭琪周 袁春 |

| |

| 作者单位: | 清华大学 计算机科学与技术系,北京 100084;清华大学 深圳国际研究生院,广东 深圳 518055;鹏城实验室,广东 深圳 518055 |

| |

| 基金项目: | 国家自然科学基金(U1833101);深圳市基础研究项目(JCYJ20190809172201639) |

| |

| 摘 要: |

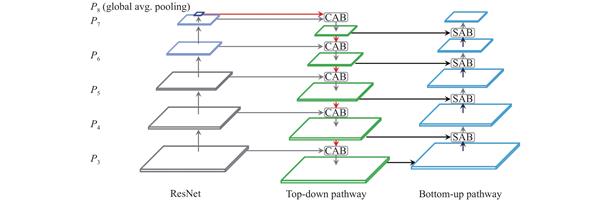

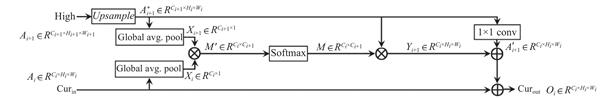

高质量的特征表示可以提高目标检测和其他计算机视觉任务的性能.现代目标检测器诉诸于通用的特征金字塔结构以丰富表示能力,但是他们忽略了对于不同方向的路径应当使用不同的融合操作,以满足其对信息流的不同需求.提出了分离式空间语义融合(separated spatial semantic fusion,SSSF),它在自上而下的路径中使用通道注意模块(channel attention block,CAB)来传递语义信息,在自下而上的路径中使用具有瓶颈结构的空间注意模块(spatial attention block,SAB)来通过较少的参数和较少的计算量(相比于直接利用不降维的空间注意模块)将精确的位置信号传递到顶层.

SSSF十分有效,并且具有很强大的泛化能力:对于目标检测,它可以将AP提高1.3%以上,对于自上而下的路径进行语义分割的融合操作,它可以将普通加和版本的AP提高约0.8%,对于实例分割,所提方法能够在所有指标上提高实例分割的包围框AP和掩膜AP.

|

| 关 键 词: | 目标检测 特征融合 注意力机制 深度学习 图像分割 |

| 收稿时间: | 2020-11-30 |

| 修稿时间: | 2020-12-28 |

| 本文献已被 万方数据 等数据库收录! |

| 点击此处可从《软件学报》浏览原始摘要信息 |

|

点击此处可从《软件学报》下载免费的PDF全文 |

|